原文来源:arXiv

「机器人圈」编译:嗯~阿童木呀、BaymaxZ

7月中旬,来自伊利诺伊大学厄巴纳―香槟分校的4位研究人员Jiajun Lu、Hussein Sibai 、Evan Fabry、David Forsyth发布了一篇关于对抗样本的论文,名为《不用担心无人驾驶汽车在目标检测中的对抗样本(NO Need to Worry about Adversarial Examples in Object Detection in Autonomous Vehicles)》(机器人圈第一时间进行了报道:点击此链接查看详情)该论文认为,应用于停止标志检测的现有对抗扰动方法只能在非常仔细挑选的情况下才有效,在许多实际情况下,特别是无人驾驶不需要担心,因为一个训练好的神经网络绝大部分情况会从不同距离和角度拍摄对抗样本。此文一发,立马引起了争议。

OpenAI在第一时间便在自己的博客上进行了回击,他们认为物理世界是有稳定的对抗样本的,详见(https://blog.openai.com/robust-adversarial-inputs/)。

这不,又有人反驳了。来自华盛顿大学、密西根大学安娜堡分校、纽约州立大学石溪分校、加利福尼亚大学伯克利分校的8名工作人员,他们提出了一种新的攻击算法,而这种算法有效地把无人驾驶的神经网络给“黑”了,我们一起来看看,他们是如何做到的。

众所周知,基于深度神经网络的分类器很容易受到对抗样本的影响,即通过添加小幅度干扰而从导致对输入的错误分类。然而,最近的研究结果表明,这种对抗样本在现实世界中并不是非常有效的——它们完全不会导致错误分类,或者仅在相对复杂的图像受到干扰且打印在纸上的限制性情况下才会发生。在本文中,我们提出了一种新的攻击算法——鲁棒物理干扰(RP2)——通过在不同条件下拍摄图像以产生干扰。我们的算法可以产生模拟破坏或艺术的空间约束性干扰,以减少偶然观察者检测到的似然值。我们展示了RP2所产生的对抗样本通过使用捕捉物理世界条件的评估方法,在各种条件下实现真正的道路标志识别的高成功率。实际上,我们实现并评估了两次攻击,一个是以100%的概率将停车标志错误分类为测试条件的速度限制标志,另一个以100%的概率将右转标志错误分类为测试条件下的停车或添加车道标志。

从语音处理到医疗诊断,尽管深度神经网络(DNN)已经在很多领域取得了巨大的成功,但最近的研究结果表明,它们很容易受到对抗干扰。对DNN输入所进行的这种恶意制作的改变将会导致它们以一种意想不到的和存在潜在危险的方式行事。

然而,这种攻击在现实世界中的有效性却受到并行和独立研究的质疑。一方面,Jiajun Lu等人研究了快速梯度符号法、迭代法和L-BFGS算法,并声称,当打印在纸上时,不同的观察条件(改变角度和距离)对路标分类器所产生的干扰是无效的。另一方面,Athalye和Sutskever表明,更复杂的算法可以产生受干扰图像,当打印出来时,这些图像对相机视角的变化具有很好的鲁棒性。

虽然以前的研究在对现实世界分类器的攻击方面取得了显著进展,但是仍然存在几个有关现实可实现性的关键缺口。首先,对目标的背景添加干扰是不可行的。第二,在诸如路标等简单的目标中隐藏干扰,要比在用于并行工作中的复杂图像中进行此操作困难得多。第三,对干扰的不可察觉性有附加的物理性限制——当前的方法产生非常高度微妙的干扰,以致相机可能无法在广泛变化的条件(长距离和广角)中对它们进行捕捉。

在此项研究中,我们探讨了以下几个关键问题:“是否有可能在物理世界的目标上制造出具有鲁棒性而又微妙的对抗干扰?”而我们之所以专注于路标分类,主要是因为其在道路安全和安防方面的关键功能。如果是攻击者能够以物理性的和具有鲁棒性的方法来操纵路标,如通过基于机器学习的视觉系统将停车标志解释为速度限制标志,然后可能导致严重的后果。我们的目标是深刻地研究物理世界的细微差别,并且证明,在现实假设下物理对抗干扰可以强有力地存在。

创造物理世界中的对抗干扰需要克服几个基于环境因素的挑战:

(1)车辆相机与道路标志之间的距离要根据具体道路、特定车辆、车道数量和车辆相对于标志的位置而不断变化;

(2)摄像机的角度相对于标志的变化;

(3)照明;

(4)路标上或车辆上的碎片。

此外,物理干扰制造过程中存在的缺陷可以降低攻击的有效性。因此,用于车辆视觉的DNN中的具有鲁棒性和有效性的攻击必须能够容忍多个误差源。此外,当前的对抗算法旨在创建人类不可察觉的干扰。在物理世界中,不可察觉性会影响干扰的鲁棒性——道路标志的修改可能非常微妙,以至于摄像机可能无法察觉到这些变化。此外,可以添加干扰的区域是非常有限的。在数字图像中,算法可以在各个地方自由地添加干扰,包括拍摄图像时路标后面出现的任何背景图像。在物理世界中,在标志的背景中添加干扰是不可行的(因为没有固定的背景),从而限制了路标本身的干扰。

通过我们对以上问题的分析,以及最近的研究,我们设计和评估了鲁棒物理干扰(RP2),第一种攻击算法,即针对改变摄像机的距离、角度和分辨率的鲁棒性。RP2仅仅干扰的是标志的区域,而不是实际中变化的背景。我们为目标函数添加一个掩码矩阵,以实现干扰的空间约束性。

使用这种提出的算法,我们引入了两类物理攻击:

(1)海报打印攻击(poster-printing attacks),即攻击者在纸上打印实际大小的路标并将其覆盖到现有标志上。

(2)贴纸攻击(sticker attacks),即攻击者仅仅编造干扰,然后把它们粘在现有的路标上。

为了使我们的攻击对人类观察者来说不那么显眼,我们生成的是看起来相对常见的具有破坏行为的的贴纸干扰。对于海报打印攻击,我们展示的一些非常微妙的干扰——占据整个标志区域的小幅度干扰(不包括任何背景图像,且只有非常仔细的观察者才会注意到)。对于贴纸攻击,我们展示了涂鸦和抽象艺术的伪装攻击。我们的两个攻击类都不需要特殊的资源——只需要彩色打印机和相机就行了。

我们在不同距离、角度和分辨率下的道路标志分类器上所进行的实验结果表明,我们可以创建鲁棒的物理攻击:在一个具有真正的停车标志与伪装抽象艺术干扰的贴纸攻击中,我们展示了在所有受控测试条件下,停止标志被可靠地错误分类为速度限制45标志。因此,RP2回答了一个关键的基本问题,即现实世界中图像分类器对对抗输入的敏感性问题。

在最近的研究中,主要探讨了在现实世界中的对抗干扰是否有效。我们将现存的这些干扰分为两种类型:

(1)微妙干扰(subtle perturbations),即干扰的幅度太小,以至于一般的人类观察者感受不到;

(2)伪装干扰(camouflage perturbations),即干扰的幅度不一定是非常小,但是主要集中于定义区域,且以诸如涂鸦或是艺术这类不起眼的形式存在。

下面我们就来简单了解一下微妙干扰。

Kurakin等人已经展示了当观察通过智能手机拍摄的照片时,打印对抗样本是如何被错误地分类的。这种攻击巧妙地处理了图像的数字化表示,然后打印出被处理的图像,即通过智能手机摄像头将图像输入给分类器。意识到这种对道路标志的攻击在物理上可能会引起人类观察者的关注,因为这种方法需要将干扰添加到路标的背景中(除了在图像中添加干扰)。请参阅下图1,以了解我们所说的背景图像。

当前的对抗深度学习算法扰乱了背景图像(波动区域)以及主要对象(停车标志)。

在现实世界中,没有固定的道路标志——它可以根据观察者的视角变化而变化。这意味着,Kurakin所述的攻击的物理部署需要在纸上打印出背景,当然路标本身是不需要的。背景是对环境的一个非常明显的补充。与此相反,我们引入了一种基于优化的方法,它将空间约束限制在道路标志的区域内。此外,我们在空间约束性干扰也可以应用到打印出来的路标上,也可以以“贴纸攻击”的形式应用到现有的物理路标上。此外,通过我们的评估方法,我们发现我们的攻击对更广范围的不同的距离和角度来说是强大的。

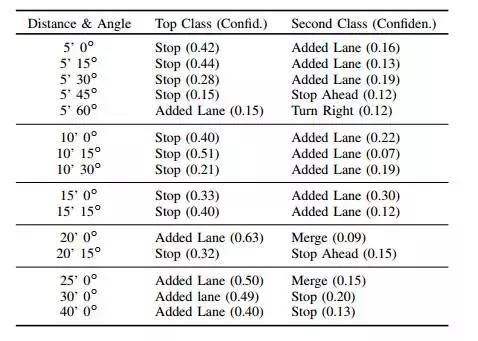

表一:具有海报打印停车标志以及真实停车标志的目标物理干扰实验的综合结果。在所有的攻击中,我们试图将停车标志错误分类到速度限制45标志,并且我们报告了前两个类以及置信度值。伪装攻击以“爱恨(LOVE HATE)”字样的形式增加了干扰。抽象艺术攻击为标志添加了两个黑色和两个白色矩形。微妙攻击将整个区域的干扰传播到整个区域。每个攻击列都列出了分类器做出的前两个预测以及预测的置信度。图例说明:SL45 =速度限制45,STP =停车,YLD =产量,ADL =增加车道,SA =信号提前,LE =车道末端。

表2:在不同距离和角度上进行的右转标志—海报打印干扰(褪色箭头)。 测试条件下,我们的攻击获得66.7%的成功。

下面我们展示一些表一和表2中所提及的实验样本图像。

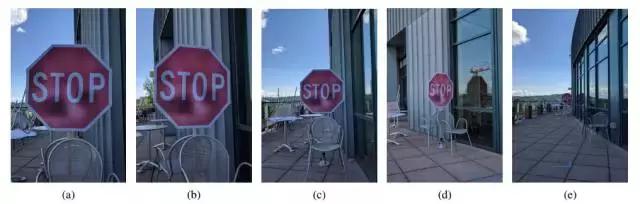

微妙海报实验中从不同距离和角度拍摄的实验图像样本。从右到左:(a)5'0°(b)5'15°(c)10'0°(d)10'30°(e)40'0°

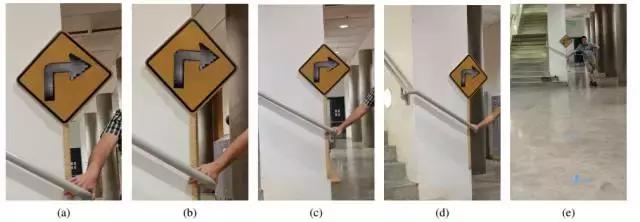

右转标志实验中从不同距离和角度拍摄的实验样本图像。从右到左:(a)5'0°(b)5'15°(c)10'0°(d)10'30°(e)40'0°

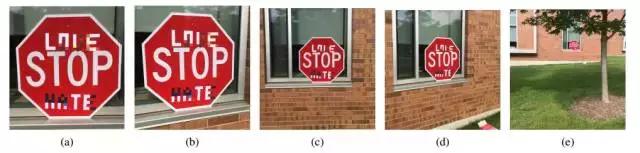

伪装涂鸦贴纸实验从不同距离和角度拍摄的实验样本图像。从右到左:(a)5'0°(b)5'15°(c)10'0°(d)10'30°(e)40'0°

结论

在本文中,我们引入了具有鲁棒性的物理干扰(RP2),即一种具有鲁棒性的,物理上可实现的对抗干扰算法。以前的算法假设DNN的输入可以通过数字化修改来实现错误分类,但这样的假设是不可行的,因为具有DNN输入控制权的攻击者可以用他所选择的输入替代它。因此,对抗攻击算法必须在物理上实施干扰,在这样做时,需要考虑到所面临的新的挑战,如由于距离、摄像机角度、不同的照明条件和标志的遮挡等所带来的视角的改变。此外,在干扰的生成过程中由于打印机中的色域有限而引入了新的错误源。

我们使用RP2创建两种类型的干扰:微妙扰动,这对整个标志来说非常的小,以至不可检测的变化;伪装干扰,这是一种以涂鸦或艺术形式呈现的的可见干扰。当停车标志被打印出来时,微妙干扰在不同的物理条件下100%地愚弄了分类器。而当只将干扰添加到标志中时,分类器就被迷彩的涂鸦和艺术干扰所迷惑,分别在不同的物理条件下达到66.7%和100%地愚弄了分类器。最后,当一个没有目标的海报伪装干扰被覆盖在一个右转标志上时,这个分类器将会被100%地愚弄。在未来的工作中,我们将计划通过改变我们在本文中没有考虑到的其他一些条件进一步测试我们的算法,,例如标志遮挡等。

了解更多信息,欢迎下载论文原文:https://arxiv.org/pdf/1707.08945v1.pdf返回搜狐,查看更多

责任编辑: